L'IA en cybersécurité : son utilisation et les 8 derniers développements

Les technologies d'intelligence artificielle (IA) et d'apprentissage automatique alimentent certaines capacités de cybersécurité depuis des décennies. Les outils antivirus, de filtrage de spam et de détection de phishing en sont quelques exemples.

Cependant, les récents progrès de l'IA ont conduit à une explosion d'intérêt autour des capacités de cybersécurité alimentées par l'IA. Cela a entraîné un nombre sans précédent de sorties de produits, d'investissements et de discours autour de l'IA en cybersécurité.

Pour comprendre comment l'IA a déjà façonné et continuera à façonner la cybersécurité, nous expliquerons comment l'IA est utilisée en cybersécurité, en commençant par des cas d'utilisation plus établis ainsi que certains des derniers développements.

Avantages de l'IA en cybersécurité

La cybersécurité présente des défis uniques, y compris un paysage de menaces en constante évolution, une vaste surface d'attaque et une pénurie de talents significative.

Étant donné que l'IA peut analyser des volumes massifs de données, identifier des modèles que les humains pourraient manquer, et adapter et améliorer ses capacités au fil du temps, elle présente des avantages significatifs lorsqu'elle est appliquée à la cybersécurité, notamment :

- Amélioration de l'efficacité des analystes en cybersécurité

- Identification et prévention des cybermenaces plus rapidement

- Réponse efficace aux cyberattaques

- Réduction des coûts de cybersécurité

Considérez l'impact de l'IA de sécurité et de l'automatisation sur les coûts moyens des violations de données et les cycles de vie des violations. Selon une enquête d'IBM, les organisations qui utilisent largement l'IA de sécurité et l'automatisation rapportent un coût moyen d'une violation de données de 3,60 millions de dollars, soit 1,76 million de dollars de moins que les violations dans les organisations qui n'utilisaient pas les capacités de sécurité d'IA et d'automatisation. Cela représente une différence de 39,3 % dans le coût moyen des violations. Les organisations avec une IA de sécurité et une automatisation pleinement déployées ont également pu identifier et contenir une violation de données 108 jours plus rapidement que les entreprises sans IA de sécurité et automatisation déployées.

Même les organisations ayant une utilisation limitée de l'IA et de l'automatisation de la sécurité ont signalé un coût moyen de violation de données de 4,04 millions de dollars, soit 1,32 million de dollars de moins ou une différence de 28,1 % par rapport à une non-utilisation. Les organisations ayant une utilisation limitée ont également constaté une accélération significative du temps d'identification et de containment d'une violation, avec une moyenne de 88 jours de gain par rapport aux organisations n'utilisant pas l'IA et l'automatisation de la sécurité.

Pour mieux comprendre l'impact de l'IA sur la cybersécurité, examinons quelques exemples spécifiques de la manière dont l'IA est utilisée en cybersécurité ci-dessous.

Lectures recommandées

35+ statistiques sur l'IA pour mieux comprendre son rôle dans la cybersécurité [2023]

Exemples de l'IA en cybersécurité

De nombreuses organisations utilisent déjà l'IA pour rendre la cybersécurité plus gérable, plus efficace et plus performante. Voici ci-dessous quelques-unes des principales applications de l'IA en cybersécurité.

1. Détection des menaces

La détection des menaces est l'une des applications les plus courantes de l'IA en cybersécurité. L'IA peut collecter, intégrer et analyser des données provenant de centaines, voire de milliers de points de contrôle, y compris les journaux système, les flux réseau, les données des points de terminaison, les appels d'API cloud et les comportements des utilisateurs. En plus de fournir une plus grande visibilité sur les communications réseau, le trafic et les dispositifs de point de terminaison, l'IA peut également reconnaître des modèles et des comportements anormaux pour identifier les menaces de manière plus précise à grande échelle.

Par exemple, les systèmes de sécurité hérités analysaient et détectaient les malwares uniquement en fonction de signatures, tandis que les systèmes alimentés par l'IA et le ML peuvent analyser les logiciels en fonction de caractéristiques inhérentes, comme s'ils sont conçus pour chiffrer rapidement de nombreux fichiers en une seule fois, et les étiqueter comme malwares. En identifiant en temps réel les comportements système et utilisateur anormaux, ces systèmes alimentés par l'IA et le ML peuvent bloquer à la fois les malwares connus et inconnus avant qu'ils ne s'exécutent, ce qui en fait une solution beaucoup plus efficace que la technologie basée sur les signatures.

2. Gestion des menaces

Une autre application importante de l'IA en cybersécurité est la gestion des menaces.

Considérez que 59 % des organisations reçoivent plus de 500 alertes de sécurité cloud par jour et 38 % en reçoivent plus de 1 000, selon une enquête de Orca Security. 43 % des décideurs IT dans ces organisations ont déclaré que plus de 40 % des alertes étaient des faux positifs et 49 % ont déclaré que plus de 40 % étaient de faible priorité. Bien que 56 % des répondants passent plus de 20 % de leur journée à examiner les alertes et à décider lesquelles doivent être traitées en priorité, plus de la moitié (55 %) ont déclaré que leur équipe avait manqué des alertes critiques dans le passé en raison d'une priorisation inefficace des alertes.

Cela entraîne une série de problèmes, y compris des alertes critiques manquées, du temps perdu à poursuivre de faux positifs et une fatigue des alertes qui contribue au turnover des employés.

Afin de lutter contre ces problèmes, les organisations peuvent utiliser l'IA et d'autres technologies avancées comme l'apprentissage automatique pour compléter les efforts de ces experts humains. L'IA peut analyser de vastes quantités de données pour identifier les menaces potentielles et filtrer les activités non menaçantes afin de réduire les faux positifs à une échelle et une vitesse que les défenseurs humains ne peuvent égaler.

En réduisant le temps nécessaire pour analyser, enquêter et prioriser les alertes, les équipes de sécurité peuvent passer plus de temps à remédier à ces alertes, ce qui prend en moyenne trois jours ou plus selon 46% des répondants à l'enquête Orca Security.

3. Réponse aux menaces

L'IA est également utilisée efficacement pour automatiser certaines actions afin d'accélérer les temps de réponse aux incidents. Par exemple, l'IA peut être utilisée pour automatiser les processus de réponse à certaines alertes. Supposons qu'un échantillon connu de logiciels malveillants apparaisse sur l'appareil d'un utilisateur final. Une réponse automatisée pourrait alors consister à couper immédiatement la connectivité réseau de cet appareil pour empêcher l'infection de se propager au reste de l'entreprise.

Les capacités d'automatisation pilotées par IA peuvent non seulement isoler les menaces par appareil, utilisateur ou emplacement, elles peuvent également initier des mesures de notification et d'escalade. Cela permet aux experts en sécurité de consacrer leur temps à enquêter et à remédier à l'incident.

Liste de contrôle de la cybersécurité IA 2024

Téléchargez cette liste de contrôle pour obtenir des conseils étape par étape sur la façon de tirer parti du potentiel de l'IA dans votre programme de cybersécurité en 2024 et au-delà.

Derniers développements en cybersécurité IA

Lorsqu'on leur a demandé ce qu'ils aimeraient voir davantage dans la sécurité en 2023, la principale réponse d'un groupe d'environ 300 décideurs en sécurité informatique était l'IA. De nombreuses entreprises de cybersécurité répondent déjà en renforçant leurs capacités basées sur l'IA.

Jetons un coup d'œil à certaines des dernières innovations ci-dessous.

1. Remédiation pilotée par l'IA

Des applications plus avancées de l'IA aident les équipes de sécurité à remédier aux menaces plus rapidement et plus facilement. Certains outils basés sur l'IA peuvent aujourd'hui traiter les alertes de sécurité et offrir aux utilisateurs des instructions de remédiation étape par étape basées sur les informations fournies par l'utilisateur, ce qui donne lieu à des recommandations de remédiation plus efficaces et personnalisées.

Secureframe Comply AI fait exactement cela pour les tests de cloud défaillants. En utilisant l'infrastructure en tant que code (IaC), Comply AI pour la remédiation génère automatiquement des conseils de remédiation adaptés à l'environnement des utilisateurs afin qu'ils puissent facilement mettre à jour le problème sous-jacent à l'origine de la configuration défaillante dans leur environnement. Cela leur permet de corriger les contrôles défaillants pour passer les tests, d'être prêts pour l'audit plus rapidement et d'améliorer leur posture globale en matière de sécurité et de conformité.

Lectures recommandées

Présentation de Secureframe Comply AI : remédiation de cloud plus rapide et personnalisée

2. Intelligence des menaces améliorée à l'aide de l'IA générative

L'IA générative est de plus en plus déployée dans les solutions de cybersécurité pour transformer la manière dont les analystes travaillent. Plutôt que de s'appuyer sur des langages de requête complexes, des opérations et de l'ingénierie inverse pour analyser de vastes quantités de données afin de comprendre les menaces, les analystes peuvent compter sur des algorithmes d'IA générative qui scannent automatiquement le code et le trafic réseau à la recherche de menaces et fournissent des informations riches.

Google’s Cloud Security AI Workbench en est un exemple éminent. Cette suite d'outils de cybersécurité est alimentée par un modèle de langage d'IA spécialisé appelé Sec-PaLM et aide les analystes à trouver, résumer et agir sur les menaces de sécurité. Prenons VirusTotal Code Insight, par exemple, qui est alimenté par Security AI Workbench. Code Insight produit des résumés en langage naturel de fragments de code afin d'aider les experts en sécurité à analyser et expliquer le comportement des scripts malveillants. Cela peut améliorer leur capacité à détecter et atténuer les attaques potentielles.

Lectures recommandées

IA générative dans la cybersécurité : comment elle est utilisée + 8 exemples

3. Automatisation des questionnaires de sécurité via l'IA générative

Les questionnaires de sécurité sont une méthode courante pour évaluer les fournisseurs potentiels et autres tiers afin de déterminer si leurs pratiques de cybersécurité répondent aux exigences internes et externes. Bien qu'ils soient importants pour la gestion des risques fournisseurs, ils peuvent prendre beaucoup de temps. L'IA peut aider à accélérer ce processus en suggérant des réponses basées sur des questionnaires précédemment remplis. Certains outils d'IA plus puissants peuvent même extraire les politiques et contrôles de sécurité d'une organisation lors de la suggestion de réponses pour être aussi précis que possible.

Secureframe Questionnaire Automation, par exemple, utilise l'IA générative pour suggérer des réponses qui s'inspirent des politiques, des tests et des contrôles d'une organisation ainsi que des réponses précédentes stockées dans leur base de connaissances pour améliorer encore la précision et les économies de temps pour les utilisateurs. Il reformulera même les réponses en utilisant le contexte hébergé dans leur base de connaissances. En utilisant l'IA pour automatiser la collecte des réponses aux questionnaires de sécurité à partir de multiples sources et analyser et reformuler intelligemment les réponses, cette solution d'IA garantit que les réponses sont cohérentes, précises et adaptées aux exigences spécifiques de chaque question, et aide les organisations à économiser des centaines d'heures à répondre à des questionnaires de sécurité fastidieux.

4. Sécurité renforcée des mots de passe grâce aux LLMs

Selon de nouvelles recherches, l'IA peut craquer la plupart des mots de passe couramment utilisés instantanément. Par exemple, une étude de Home Security Heroes a prouvé que 51 % des mots de passe courants peuvent être craqués par l'IA en moins d'une minute.

Bien qu'il soit effrayant de penser à ce pouvoir entre les mains des pirates, l'IA a également le potentiel d'améliorer la sécurité des mots de passe lorsqu'elle est bien utilisée. Les grands modèles de langage (LLMs) entraînés sur d'énormes violations de mots de passe comme PassGPT ont le potentiel d'améliorer la complexité des mots de passe générés ainsi que les algorithmes d'estimation de la force des mots de passe. Cela peut aider à améliorer l'hygiène des mots de passe des individus et la précision des estimateurs de force actuels.

5. Capacités de tromperie dynamiques via l'IA

Alors que les acteurs malveillants chercheront à exploiter les capacités de l'IA pour alimenter des techniques de tromperie telles que les deepfakes, l'IA peut également être utilisée pour alimenter des techniques de tromperie qui défendent les organisations contre les menaces avancées.

Les plateformes de technologie de tromperie intègrent de plus en plus l'IA pour tromper les attaquants avec des projections de vulnérabilités réalistes et des appâts et leurres efficaces. La plateforme ShadowPlex alimentée par l'IA d'Acalvio, par exemple, est conçue pour déployer des tromperies dynamiques, intelligentes et hautement évolutives à travers le réseau d'une organisation.

6. Questionnaires fournisseurs simplifiés à l'aide de l'IA

Les évaluations des fournisseurs sont un aspect crucial de la gestion des risques des fournisseurs, aidant les organisations à évaluer les pratiques de sécurité, la conformité et les risques des fournisseurs potentiels avant d'établir des relations commerciales. Traditionnellement, ces évaluations étaient des processus manuels qui prenaient une quantité significative de temps et de ressources d'une organisation. Étant donné que l'IA est capable d'analyser des quantités massives de données beaucoup plus rapidement que les humains, les outils d'IA peuvent grandement simplifier et accélérer les évaluations des fournisseurs.

Comply AI pour VRM, par exemple, rationalise le processus d'évaluation de la sécurité. Les clients de Secureframe peuvent non seulement envoyer des questionnaires personnalisés ou basés sur des modèles directement depuis la plateforme Secureframe et recevoir les réponses des fournisseurs automatiquement postées sur la plateforme pour une gestion centralisée, mais ils peuvent également utiliser Comply AI pour VRM afin d'extraire automatiquement des réponses pertinentes des documents hébergés des fournisseurs, tels que les rapports SOC 2. Cela permet aux fournisseurs de gagner du temps en évitant de répondre à chaque question individuellement, augmentant ainsi l'efficacité et la précision des examens de sécurité.

7. Développement assisté par l'IA

En 2023, la CISA a publié un ensemble de principes pour le développement de produits sécurisés par conception. L'objectif est de réduire les violations de sécurité, d'améliorer la cybersécurité nationale et de réduire les coûts de maintenance et de patching des développeurs. Cependant, cela augmentera probablement les coûts de développement.

En conséquence, les développeurs commencent à utiliser des outils de développement assistés par l'IA pour réduire ces coûts et améliorer leur productivité tout en créant des logiciels plus sécurisés. GitHub Copilot est un exemple relativement nouveau mais prometteur. Dans une enquête auprès de plus de 2 000 développeurs, les développeurs qui ont utilisé GitHub Copilot ont accompli une tâche 55% plus rapidement que ceux qui ne l'ont pas utilisé.

8. Gestion des correctifs basée sur l'IA

Alors que les pirates continuent d'utiliser de nouvelles techniques et technologies pour exploiter les vulnérabilités, les approches manuelles de gestion des correctifs ne peuvent pas suivre le rythme et laissent les surfaces d'attaque non protégées et vulnérables aux violations de données. La recherche dans le Rapport 2023 sur l'état de la remédiation des vulnérabilités d'Action1 a révélé que 47% des violations de données résultaient de vulnérabilités de sécurité non corrigées, et plus de la moitié des organisations (56%) remédient aux vulnérabilités de sécurité manuellement.

Les systèmes de gestion des correctifs basés sur l'IA peuvent aider à identifier, prioriser et même traiter les vulnérabilités avec beaucoup moins d'intervention manuelle que les systèmes hérités. Cela permet aux équipes de sécurité de réduire les risques sans augmenter leur charge de travail.

Par exemple, GitLab a récemment publié une nouvelle fonctionnalité de sécurité qui utilise l'IA pour expliquer les vulnérabilités aux développeurs, avec des plans pour étendre cela afin de les résoudre automatiquement à l'avenir.

9. Tests de pénétration automatisés

Les tests de pénétration sont un processus complexe et multi-étapes qui implique la collecte d'informations sur l'environnement d'une entreprise, l'identification des menaces et des vulnérabilités, puis l'exploitation de ces vulnérabilités pour essayer d'accéder aux systèmes ou aux données. L'IA peut aider à simplifier ces parties du processus en scannant rapidement et efficacement les réseaux et en collectant d'autres données, puis en déterminant la meilleure marche à suivre ou le chemin d'exploitation pour le testeur de pénétration.

Bien qu'il s'agisse d'un domaine relativement naissant de la cybersécurité de l'IA, il existe déjà un mélange d'outils open-source comme DeepExploit et d'outils propriétaires comme NodeZero offrant une alternative plus rapide, plus abordable et évolutive aux services traditionnels de tests de pénétration. DeepExploit, par exemple, est un outil de test de pénétration entièrement automatisé qui utilise l'apprentissage automatique pour améliorer plusieurs parties du processus de test de pénétration, y compris la collecte de renseignements, la modélisation des menaces, l'analyse des vulnérabilités et l'exploitation. Cependant, il est encore en mode bêta.

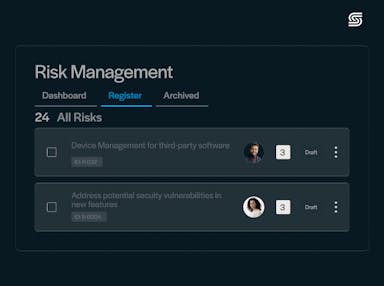

10. Évaluations de risques assistées par l'IA

L'IA est également utilisée pour automatiser les évaluations de risques, améliorant ainsi la précision et la fiabilité et permettant aux équipes de cybersécurité de gagner un temps considérable. Ces types d'outils d'IA peuvent évaluer et analyser les risques en fonction des données existantes d'une bibliothèque de risques et d'autres sources de données, et générer automatiquement des rapports de risque.

Secureframe Comply AI for Risk, par exemple, peut produire des informations détaillées sur un risque en un seul clic, en utilisant uniquement une description du risque et des informations sur l'entreprise. Cette solution alimentée par l'IA peut déterminer la probabilité et l'impact d'un risque avant une réponse, suggérer un plan de traitement pour répondre au risque, et définir la probabilité résiduelle et l'impact du risque après le traitement. Ces sorties détaillées de Comply AI for Risk aident les organisations à mieux comprendre l'impact potentiel d'un risque et les méthodes d'atténuation appropriées, améliorant ainsi leur sensibilisation aux risques et leur réponse.

Lectures recommandées

Développez votre organisation en toute confiance et réduisez les risques avec la nouvelle gestion des risques de Secureframe

IA et cybercriminalité

Alors que l'IA est appliquée de nombreuses manières pour améliorer la cybersécurité, elle est également utilisée par les cybercriminels pour lancer des attaques de plus en plus sophistiquées à un rythme sans précédent.

En fait, 85 % des professionnels de la sécurité qui ont constaté une augmentation des cyberattaques au cours des 12 derniers mois attribuent cette hausse aux acteurs malveillants utilisant l'IA générative.

En raison des cyberattaques alimentées par l'IA ainsi que d'autres facteurs, la cybercriminalité devrait coûter 10,5 trillions de dollars dans le monde d'ici 2025.

Voici quelques-unes des façons dont l'IA est utilisée dans la cybercriminalité :

- Les ingénieurs sociaux utilisent ChatGPT pour rédiger des e-mails de phishing plus crédibles et légitimes.

- Les ingénieurs sociaux utilisent également des algorithmes d'apprentissage automatique combinés à des logiciels de mapping facial pour créer des deepfakes convaincants.

- Les acteurs malveillants utilisent l'IA pour lancer des attaques à la vitesse de la machine, c'est-à-dire des ransomwares et autres attaques automatisées qui se propagent et/ou mutent très rapidement et qu'il est pratiquement impossible de neutraliser à l'aide de mécanismes de réponse dépendant de l'humain.

- Les hackers utilisent le support de l'IA pour deviner des mots de passe et casser des CAPTCHA afin d'obtenir un accès non autorisé à des données sensibles.

- Les acteurs de la menace créent des IA capables d'identifier de manière autonome des vulnérabilités, de planifier et de mener des campagnes d'attaque, d'utiliser la furtivité pour éviter les défenses et de collecter et exploiter des données provenant de systèmes infectés et de renseignements en source ouverte.

Les organisations qui utilisent largement l'IA et l'automatisation pour améliorer leurs capacités de cybersécurité seront les mieux placées pour se défendre contre l'utilisation armée de l'IA par les cybercriminels. Dans une étude de Capgemini Research Institute, 69 % des dirigeants disent que l'IA entraîne une plus grande efficacité pour les analystes en cybersécurité de l'organisation. 69 % pensent également que l'IA est nécessaire pour répondre efficacement aux cyberattaques. Trouvez plus de statistiques sur l'impact positif de l'IA dans la cybersécurité.

Lectures recommandées

70+ statistiques sur la cybersécurité pour inspirer l'action cette année

Comment l'IA en cybersécurité est-elle améliorée ?

En réponse à ces menaces émergentes, l'IA en cybersécurité est continuellement améliorée pour suivre le rythme des cybercriminels et adapter ses capacités au fil du temps.

Voici des moyens clés par lesquels l'IA de cybersécurité est améliorée.

1. Meilleure formation pour les modèles d'IA

Les modèles d'IA bénéficient d'une meilleure formation grâce à l'augmentation de la puissance de calcul et à la taille des données d'entraînement. En ingérant de plus grandes quantités de données, ces modèles ont plus d'exemples à apprendre et peuvent tirer des conclusions plus précises et nuancées des exemples qui leur sont présentés.

En conséquence, les outils d'IA de cybersécurité sont meilleurs pour identifier les schémas et les anomalies dans les grands ensembles de données et pour apprendre des incidents passés, ce qui leur permet de prédire plus précisément les menaces potentielles, entre autres cas d'utilisation de la cybersécurité.

2. Progrès dans la technologie de traitement du langage

Grâce à l'augmentation des ressources de données et de la puissance de calcul, la technologie de traitement du langage a fait des avancées significatives ces dernières années. Ces avancées, y compris des capacités améliorées à apprendre à partir de données complexes et sensibles au contexte, amélioreront considérablement les outils d'IA de cybersécurité qui génèrent automatiquement des instructions pas à pas, des renseignements sur les menaces et d'autres codes ou textes.

3. Intégration des renseignements sur les menaces

Les systèmes d'IA de cybersécurité sont améliorés en s'intégrant aux flux de renseignements sur les menaces. Cela leur permet de rester à jour sur les dernières informations sur les menaces et d'ajuster leurs défenses en conséquence.

4. Apprentissage profond

Une sous-catégorie de l'apprentissage machine, l'apprentissage profond est un réseau neuronal avec trois couches ou plus. En simulant le comportement du cerveau humain, ces réseaux neuronaux tentent d'apprendre à partir de grandes quantités de données et de faire des prédictions plus précises qu'un réseau neuronal à une seule couche.

En raison de sa capacité à traiter de vastes quantités de données et à reconnaître des schémas complexes, la technologie d'apprentissage profond contribue à des recherches de menaces, une gestion et une réponse plus précises.

5. Plus de ressources pour le développement et l'utilisation de l'IA

Alors que le développement et l'utilisation de l'IA continuent de monter en flèche dans la cybersécurité et d'autres industries, les gouvernements et d'autres organismes autoritaires comme NIST, CISA et OWASP publient des ressources pour aider les individus et les entreprises à gérer les risques tout en tirant parti des avantages. Ces ressources aideront les développeurs à disposer des meilleures pratiques pour améliorer l'IA dans la cybersécurité et au-delà. Voici quelques exemples :

Exploiter la puissance de l'IA dans votre stratégie de cybersécurité

L'IA est de plus en plus utilisée dans la cybersécurité pour récolter une gamme d'avantages, allant de l'amélioration de l'efficacité des professionnels de la cybersécurité à l'identification et la réponse aux menaces critiques en moins de temps.

Secureframe s'engage à simplifier la sécurité et la conformité avec l'IA. Ses dernières innovations IA comprennent :

- Comply AI pour la remédiation fournit des conseils de remédiation propulsés par l'IA pour aider à accélérer la remédiation cloud et le temps de conformité.

- Comply AI pour le risque automatise le processus d'évaluation des risques pour vous faire gagner du temps et réduire les coûts de maintien d'un programme de gestion des risques solide.

- Comply AI pour les politiques utilise l'IA générative afin de vous faire gagner des heures d'écriture et de raffinement des politiques.

- L'automatisation des questionnaires de Secureframe utilise l'IA afin que vous puissiez répondre rapidement aux questionnaires de sécurité et aux appels d'offres avec plus de 90% de précision.

Pour en savoir plus sur la façon dont Secureframe utilise l'automatisation et l'IA pour simplifier la sécurité et la conformité, planifiez une démo.

Guider la stratégie et la mise en œuvre de l'IA de votre organisation

Suivez ces meilleures pratiques pour mettre en œuvre efficacement l'IA tout en répondant aux préoccupations liées à la transparence, à la confidentialité et à la sécurité.

FAQ

Comment l'IA est-elle utilisée en cybersécurité ?

L'intelligence artificielle (IA) est utilisée en cybersécurité pour compléter les efforts des experts humains en automatisant des tâches hautement répétitives, manuelles et fastidieuses. Étant donné que l'IA peut analyser des volumes massifs de données, identifier des motifs que les humains pourraient manquer et améliorer ses capacités au fil du temps, elle excelle dans la détection des menaces, la gestion des menaces, la réponse aux menaces, la sécurité des points d'extrémité et la sécurité basée sur les comportements.

Qu'est-ce que l'IA responsable en cybersécurité ?

L'IA responsable en cybersécurité fait référence à la conception et au déploiement d'intelligence artificielle sûre, sécurisée et fiable dans le secteur. L'objectif est d'augmenter la transparence et de réduire les risques tels que le biais de l'IA en promouvant l'adoption de meilleures pratiques spécifiques, telles que les tests en équipe rouge.

Comment l'IA et l'apprentissage automatique changent-ils le paysage de la cybersécurité ?

L'IA et l'apprentissage automatique sont utilisés pour renforcer la cybersécurité de manière sans précédent, comme signaler des anomalies cachées, identifier des vecteurs d'attaque et répondre automatiquement aux incidents de sécurité. Ils sont également utilisés pour lancer des cyberattaques de plus en plus sophistiquées et fréquentes.

Comment l'IA est-elle utilisée en cybersécurité ?

L'IA est utilisée en cybersécurité pour automatiser des tâches hautement répétitives, fastidieuses et manuelles pour les analystes de sécurité et autres experts. Cela libère du temps et des ressources pour que les équipes de cybersécurité puissent se concentrer sur des tâches de sécurité plus complexes comme l'élaboration de politiques.

Prenons la sécurité des points de terminaison par exemple. La sécurité des points de terminaison désigne les mesures qu'une organisation met en place pour protéger des appareils comme les ordinateurs de bureau, les ordinateurs portables et les appareils mobiles contre les logiciels malveillants, les attaques de phishing et autres menaces. Pour compléter les efforts des experts humains et les politiques qu'ils mettent en place pour régir la sécurité des points de terminaison, l'IA peut apprendre le contexte, l'environnement et les comportements associés à des points de terminaison spécifiques ainsi que les types d'actifs et les services réseau. Elle peut ensuite limiter l'accès aux appareils autorisés sur la base de ces informations et empêcher totalement l'accès aux appareils non autorisés et non gérés.

Puisque l'IA peut également améliorer d'autres domaines de la cybersécurité, on s'attend à une explosion des produits de cybersécurité basés sur l'IA. En 2021, le marché mondial des produits de cybersécurité basés sur l'IA a atteint 14,9 milliards de dollars - il est estimé atteindre 133,8 milliards de dollars d'ici 2030.

Avant d'examiner de plus près l'utilisation de l'IA en cybersécurité, regardons d'abord les avantages.