IA en Ciberseguridad: Cómo se Usa + 8 Últimos Desarrollos

Las tecnologías de inteligencia artificial (IA) y aprendizaje automático han estado impulsando algunas capacidades de ciberseguridad durante décadas. Las herramientas de antivirus, filtro de spam y detección de phishing son solo algunos ejemplos.

Sin embargo, los recientes avances en IA han llevado a una explosión de interés en torno a las capacidades de ciberseguridad impulsadas por IA. Esto ha resultado en una cantidad sin precedentes de lanzamientos de productos, inversiones y debates en torno a la IA en ciberseguridad.

Para entender cómo la IA ya ha moldeado y seguirá moldeando la ciberseguridad, explicaremos cómo se usa la IA en la ciberseguridad, comenzando con los casos de uso más establecidos, así como algunos de los últimos desarrollos.

¿Cómo se usa la IA en la ciberseguridad?

La IA se usa en la ciberseguridad para automatizar tareas que son altamente repetitivas, manualmente intensivas y tediosas para que los analistas de seguridad y otros expertos las completen. Esto libera tiempo y recursos para que los equipos de ciberseguridad puedan centrarse en tareas de seguridad más complejas como la formulación de políticas.

Tomemos la seguridad de endpoints, por ejemplo. La seguridad de endpoints se refiere a las medidas que una organización implementa para proteger dispositivos como computadoras de escritorio, portátiles y dispositivos móviles contra malware, ataques de phishing y otras amenazas. Para complementar los esfuerzos de los expertos humanos y las políticas que implementan para gestionar la seguridad de los endpoints, la IA puede aprender el contexto, el entorno y los comportamientos asociados con endpoints específicos, así como tipos de activos y servicios de red. Luego, puede limitar el acceso a dispositivos autorizados basándose en estos conocimientos y prevenir totalmente el acceso a dispositivos no autorizados y no gestionados.

Dado que la IA también puede mejorar otras áreas de la ciberseguridad, se espera una explosión de productos de ciberseguridad basados en IA. En 2021, el mercado global de productos de ciberseguridad basados en IA alcanzó los $14.9 mil millones — se estima que alcanzará los $133.8 mil millones para 2030.

Antes de analizar más de cerca el uso de la IA en la ciberseguridad, veamos más de cerca los beneficios.

Beneficios de la IA en la Ciberseguridad

La ciberseguridad presenta desafíos únicos, incluyendo un panorama de amenazas en constante evolución, una amplia superficie de ataque y una significativa escasez de talento.

Dado que la IA puede analizar volúmenes masivos de datos, identificar patrones que los humanos podrían pasar por alto, y adaptar y mejorar sus capacidades con el tiempo, tiene beneficios significativos cuando se aplica a la ciberseguridad, incluyendo:

- Mejorar la eficiencia de los analistas de ciberseguridad

- Identificar y prevenir amenazas cibernéticas más rápidamente

- Responder efectivamente a los ciberataques

- Reducir los costos de la ciberseguridad

Considera el impacto de la IA en seguridad y la automatización en los costos promedio de filtraciones de datos y los ciclos de vida de las filtraciones. Según una encuesta de IBM, las organizaciones que usan IA en seguridad y automatización de manera extensiva reportan un costo promedio de una filtración de datos de $3.60 millones, que es $1.76 millones menos que las filtraciones en organizaciones que no usaron capacidades de automatización e IA en seguridad. Esta es una diferencia del 39.3% en el costo promedio de las filtraciones. Las organizaciones con IA en seguridad y automatización completamente desplegadas también pudieron identificar y contener una filtración de datos 108 días más rápido que las empresas que no tenían IA en seguridad y automatización desplegada.

Incluso las organizaciones con un uso limitado de IA de seguridad y automatización informaron un costo promedio de una violación de datos de $4.04 millones, que fue $1.32 millones menos o una diferencia del 28.1% en comparación con no usarla. Las organizaciones con un uso limitado también vieron una aceleración significativa en el tiempo para identificar y contener una violación, con un promedio de 88 días más rápido que las organizaciones que no usan IA de seguridad y automatización.

Para comprender mejor el impacto de la IA en la ciberseguridad, echemos un vistazo a algunos ejemplos específicos de cómo se utiliza la IA en la ciberseguridad a continuación.

Lectura recomendada

35+ estadísticas sobre IA para comprender mejor su papel en la ciberseguridad [2023]

Ejemplos de IA en ciberseguridad

Muchas organizaciones ya están utilizando IA para ayudar a que la ciberseguridad sea más manejable, más eficiente y más efectiva. A continuación se presentan algunas de las principales aplicaciones de la IA en la ciberseguridad.

1. Detección de amenazas

La detección de amenazas es una de las aplicaciones más comunes de la IA en ciberseguridad. La IA puede recopilar, integrar y analizar datos de cientos e incluso miles de puntos de control, incluidos registros del sistema, flujos de red, datos de endpoints, llamadas a APIs en la nube y comportamientos de usuarios. Además de proporcionar una mayor visibilidad de las comunicaciones de red, el tráfico y los dispositivos endpoint, la IA también puede reconocer patrones y comportamientos anómalos para identificar amenazas de manera más precisa a gran escala.

Por ejemplo, los sistemas de seguridad heredados analizaban y detectaban malware basándose únicamente en firmas, mientras que los sistemas potenciados por IA y ML pueden analizar el software basándose en características inherentes, como si está diseñado para cifrar rápidamente muchos archivos a la vez, y etiquetarlo como malware. Al identificar comportamientos anómalos del sistema y del usuario en tiempo real, estos sistemas potenciados por IA y ML pueden bloquear tanto malware conocido como desconocido, lo que los convierte en una solución mucho más efectiva que la tecnología basada en firmas.

2. Gestión de amenazas

Otra aplicación principal de la IA en ciberseguridad es la gestión de amenazas.

Considere que el 59% de las organizaciones reciben más de 500 alertas de seguridad en la nube por día y el 38% recibe más de 1,000, según una encuesta de Orca Security. El 43% de los responsables de decisiones de TI en estas organizaciones dijeron que más del 40% de las alertas son falsos positivos y el 49% dijo que más del 40% son de baja prioridad. A pesar de que el 56% de los encuestados pasan más del 20% de su día revisando alertas y decidiendo cuáles deben abordarse primero, más de la mitad (55%) dijo que su equipo perdió alertas críticas en el pasado debido a una priorización ineficaz de las alertas.

Esto resulta en una serie de problemas, incluidas alertas críticas perdidas, tiempo perdido persiguiendo falsos positivos y fatiga de alertas que contribuye a la rotación de empleados.

Para combatir estos problemas, las organizaciones pueden utilizar la IA y otras tecnologías avanzadas como el aprendizaje automático para complementar los esfuerzos de estos expertos humanos. La IA puede escanear grandes cantidades de datos para identificar amenazas potenciales y filtrar actividades no amenazantes para reducir los falsos positivos a una escala y velocidad que los defensores humanos no pueden igualar.

Al reducir el tiempo necesario para analizar, investigar y priorizar alertas, los equipos de seguridad pueden pasar más tiempo remediando estas alertas, lo que lleva tres o más días en promedio según el 46% de los encuestados en la encuesta de Orca Security.

3. Respuesta a amenazas

La IA también se utiliza de manera efectiva para automatizar ciertas acciones y acelerar los tiempos de respuesta a incidentes. Por ejemplo, la IA puede utilizarse para automatizar procesos de respuesta a ciertas alertas. Supongamos que una muestra conocida de malware aparece en el dispositivo de un usuario final. Entonces, una respuesta automatizada podría ser desconectar inmediatamente la conectividad de red de ese dispositivo para evitar que la infección se propague al resto de la empresa.

Las capacidades de automatización impulsadas por IA no solo pueden aislar amenazas por dispositivo, usuario o ubicación, sino que también pueden iniciar medidas de notificación y escalación. Esto permite a los expertos en seguridad dedicar su tiempo a investigar y remediar el incidente.

Lista de verificación de ciberseguridad de IA para 2024

Descarga esta lista de verificación para obtener una guía paso a paso sobre cómo aprovechar el potencial de la IA en tu programa de ciberseguridad en 2024 y más allá.

Últimos desarrollos en IA de ciberseguridad

Cuando se les preguntó qué les gustaría ver más en seguridad en 2023, la respuesta principal entre un grupo de aproximadamente 300 tomadores de decisiones de seguridad informática fue IA. Muchas empresas de ciberseguridad ya están respondiendo aumentando sus capacidades impulsadas por IA.

Echemos un vistazo a algunas de las últimas innovaciones a continuación.

1. Remediación impulsada por IA

Aplicaciones más avanzadas de IA están ayudando a los equipos de seguridad a remediar amenazas de manera más rápida y fácil. Algunas herramientas impulsadas por IA hoy en día pueden procesar alertas de seguridad y ofrecer a los usuarios instrucciones de remediación paso a paso basadas en la entrada del usuario, lo que resulta en recomendaciones de remediación más efectivas y personalizadas.

Secureframe Comply AI hace justamente eso para pruebas fallidas en la nube. Utilizando infraestructura como código (IaC), Comply AI para remediación genera automáticamente una guía de remediación personalizada para el entorno de los usuarios para que puedan actualizar fácilmente el problema subyacente que causa la configuración fallida en su entorno. Esto les permite corregir controles fallidos para pasar pruebas, estar listos para auditorías más rápidamente y mejorar su postura general de seguridad y cumplimiento.

Lectura recomendada

Presentamos Secureframe Comply AI: Remediación en la nube más rápida y personalizada

2. Inteligencia de amenazas mejorada utilizando IA generativa

La IA generativa se está desplegando cada vez más en las soluciones de ciberseguridad para transformar la forma en que trabajan los analistas. En lugar de depender de lenguajes de consulta complejos, operaciones e ingeniería inversa para analizar grandes cantidades de datos y comprender las amenazas, los analistas pueden confiar en algoritmos de IA generativa que escanean automáticamente el código y el tráfico de red en busca de amenazas y proporcionan información rica.

Google’s Cloud Security AI Workbench es un ejemplo destacado. Esta suite de herramientas de ciberseguridad está impulsada por un modelo de lenguaje de IA especializado llamado Sec-PaLM y ayuda a los analistas a encontrar, resumir y actuar sobre las amenazas de seguridad. Tome VirusTotal Code Insight, que está impulsado por Security AI Workbench, por ejemplo. Code Insight produce resúmenes en lenguaje natural de fragmentos de código para ayudar a los expertos en seguridad a analizar y explicar el comportamiento de los scripts maliciosos. Esto puede mejorar su capacidad para detectar y mitigar posibles ataques.

Lecturas recomendadas

IA generativa en ciberseguridad: cómo se está utilizando + 8 ejemplos

3. Automatización de cuestionarios de seguridad a través de IA generativa

Los cuestionarios de seguridad son una forma común de evaluar a posibles proveedores y otras terceras partes para determinar si sus prácticas de ciberseguridad cumplen con los requisitos internos y externos. Aunque son importantes para la gestión de riesgos de proveedores, pueden consumir tiempo valioso. La IA puede ayudar a acelerar este proceso sugiriendo respuestas basadas en cuestionarios respondidos anteriormente. Algunas herramientas de IA más potentes incluso pueden extraer de las políticas y controles de seguridad de una organización al sugerir respuestas para ser lo más precisas posible.

Secureframe Questionnaire Automation, por ejemplo, usa IA generativa para sugerir respuestas que se basan en las políticas, pruebas y controles de una organización, así como en respuestas anteriores almacenadas en su base de conocimientos, para mejorar aún más la precisión y el ahorro de tiempo para los usuarios. Incluso reformula respuestas utilizando el contexto alojado en su base de conocimientos. Al aprovechar la IA para automatizar la recopilación de respuestas a cuestionarios de seguridad de múltiples fuentes e inteligentemente analizar y reformular las respuestas, esta solución de IA asegura que las respuestas sean consistentes, precisas y adaptadas a los requisitos específicos de cada pregunta y ayuda a las organizaciones a ahorrar cientos de horas al responder tediosos cuestionarios de seguridad.

4. Mayor seguridad de contraseñas usando LLMs

Según nuevas investigaciones, la IA puede descifrar la mayoría de las contraseñas comúnmente utilizadas al instante. Por ejemplo, un estudio de Home Security Heroes demostró que el 51% de las contraseñas comunes pueden ser descifradas por la IA en menos de un minuto.

Aunque es aterrador pensar en este poder en manos de hackers, la IA también tiene el potencial de mejorar la seguridad de las contraseñas en las manos correctas. Modelos de lenguaje grandes (LLMs) entrenados con extensas violaciones de contraseñas como PassGPT tienen el potencial de mejorar la complejidad de las contraseñas generadas, así como los algoritmos de estimación de la fuerza de las contraseñas. Esto puede ayudar a mejorar la higiene de las contraseñas de los individuos y la precisión de los actuales estimadores de fuerza.

5. Capacidades de engaño dinámico mediante IA

Aunque los actores maliciosos buscarán capitalizar las capacidades de la IA para impulsar técnicas de engaño como los deepfakes, la IA también puede usarse para potenciar técnicas de engaño que defienden a las organizaciones contra amenazas avanzadas.

Las plataformas de tecnología de engaño están implementando cada vez más la IA para engañar a los atacantes con proyecciones realistas de vulnerabilidades y cebos y señuelos efectivos. La plataforma ShadowPlex impulsada por IA de Acalvio, por ejemplo, está diseñada para desplegar engaños dinámicos, inteligentes y altamente escalables en toda la red de una organización.

6. Cuestionarios simplificados para proveedores usando IA

Las evaluaciones de proveedores son un aspecto crucial de la gestión de riesgos de proveedores, ayudando a las organizaciones a evaluar las prácticas de seguridad, el cumplimiento y los riesgos de los proveedores potenciales antes de establecer relaciones comerciales. Tradicionalmente, estas evaluaciones han sido procesos manuales que consumen una cantidad significativa de tiempo y recursos de una organización. Dado que la IA es capaz de analizar enormes cantidades de datos mucho más rápido que los humanos, las herramientas de IA pueden simplificar y acelerar significativamente las evaluaciones de proveedores.

Comply AI para VRM, por ejemplo, optimiza el proceso de evaluación de seguridad. Los clientes de Secureframe no solo pueden enviar plantillas de cuestionarios personalizadas o basadas en plantillas directamente desde la plataforma Secureframe y tener las respuestas de los proveedores publicadas de nuevo en la plataforma automáticamente para una gestión centralizada, sino que también pueden usar Comply AI para VRM para extraer automáticamente respuestas relevantes de documentos de proveedores alojados, como informes SOC 2. Esto ahorra tiempo a los proveedores al no tener que responder a cada pregunta individualmente, mejorando la eficiencia y precisión de las revisiones de seguridad.

7. Desarrollo asistido por IA

En 2023, CISA publicó un conjunto de principios para el desarrollo de productos seguros por diseño. El objetivo es reducir las brechas, mejorar la ciberseguridad del país y reducir los costos continuos de mantenimiento y parcheo de los desarrolladores. Sin embargo, es probable que aumente los costos de desarrollo.

Como resultado, los desarrolladores están comenzando a depender de herramientas de desarrollo asistidas por IA para reducir estos costos y mejorar su productividad mientras crean software más seguro. GitHub Copilot es un ejemplo relativamente nuevo pero prometedor. En una encuesta a más de 2,000 desarrolladores, los desarrolladores que usaron GitHub Copilot completaron una tarea un 55% más rápido que los desarrolladores que no lo hicieron.

8. Gestión de parches basada en IA

A medida que los hackers continúan utilizando nuevas técnicas y tecnologías para explotar vulnerabilidades, los enfoques manuales para la gestión de parches no pueden seguir el ritmo y dejan las superficies de ataque desprotegidas y vulnerables a las brechas de datos. La investigación en el Informe sobre el Estado de la Remediación de Vulnerabilidades 2023 de Action1 encontró que el 47% de las brechas de datos resultaron de vulnerabilidades de seguridad no parchadas, y más de la mitad de las organizaciones (56%) remedia las vulnerabilidades de seguridad manualmente.

Los sistemas de gestión de parches basados en IA pueden ayudar a identificar, priorizar e incluso abordar vulnerabilidades con mucho menos intervención manual que los sistemas heredados. Esto permite a los equipos de seguridad reducir el riesgo sin aumentar su carga de trabajo.

Por ejemplo, GitLab lanzó recientemente una nueva función de seguridad que usa IA para explicar las vulnerabilidades a los desarrolladores, con planes para expandir esto a resolverlas automáticamente en el futuro.

9. Pruebas de penetración automatizadas

Las pruebas de penetración son un proceso complejo y de múltiples pasos que implica reunir información sobre el entorno de una empresa, identificar amenazas y vulnerabilidades, y luego explotar esas vulnerabilidades para tratar de acceder a sistemas o datos. La IA puede ayudar a simplificar estas partes del proceso escaneando rápidamente y de manera eficiente las redes y reuniendo otros datos, y luego determinando el mejor curso de acción o camino de explotación para el probador de penetración.

Aunque es un área relativamente incipiente de la ciberseguridad basada en IA, ya existe una mezcla de herramientas de código abierto como DeepExploit y herramientas propietarias como NodeZero que ofrecen una alternativa más rápida, asequible y escalable a los servicios tradicionales de pruebas de penetración. DeepExploit, por ejemplo, es una herramienta de prueba de penetración totalmente automatizada que utiliza el aprendizaje automático para mejorar varias partes del proceso de pruebas de penetración, incluida la recopilación de inteligencia, el modelado de amenazas, el análisis de vulnerabilidades y la explotación. Sin embargo, todavía está en modo beta.

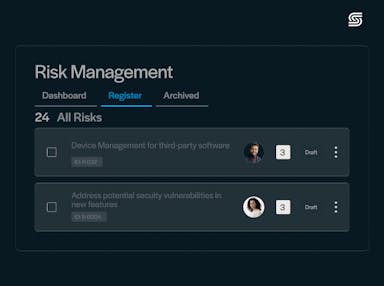

10. Evaluaciones de riesgo impulsadas por IA

La IA también se está utilizando para automatizar las evaluaciones de riesgos, mejorando la precisión y la fiabilidad y ahorrando un tiempo significativo a los equipos de ciberseguridad. Este tipo de herramientas de IA pueden evaluar y analizar riesgos basándose en datos existentes de una biblioteca de riesgos y otras fuentes de datos, y generar automáticamente informes de riesgos.

Secureframe Comply AI for Risk, por ejemplo, puede producir información detallada sobre un riesgo con un solo clic, utilizando solo una descripción del riesgo y la información de la empresa. Esta solución impulsada por IA puede determinar la probabilidad e impacto de un riesgo antes de una respuesta, sugerir un plan de tratamiento para responder al riesgo y definir la probabilidad e impacto residual del riesgo después del tratamiento. Estos resultados detallados de Comply AI for Risk ayudan a las organizaciones a comprender mejor el potencial impacto de un riesgo y los métodos de mitigación adecuados, mejorando su conciencia de riesgo y respuesta.

Lectura recomendada

Crezca con confianza su organización y reduzca el riesgo con la nueva gestión de riesgos de Secureframe

IA y cibercrimen

Si bien la IA se está aplicando de muchas maneras para mejorar la ciberseguridad, también está siendo utilizada por ciberdelincuentes para lanzar ataques cada vez más sofisticados a un ritmo sin precedentes.

De hecho, el 85% de los profesionales de seguridad que presenciaron un aumento en los ciberataques durante los últimos 12 meses atribuyen el aumento a los malos actores que utilizan IA generativa.

Como resultado de los ciberataques impulsados por IA, así como otros factores, se espera que el cibercrimen cueste 10.5 billones de dólares a nivel mundial para 2025.

A continuación se muestran solo algunas formas en las que la IA está siendo utilizada en el cibercrimen:

- Los ingenieros sociales están utilizando ChatGPT para crear correos electrónicos de phishing que suenan más creíbles y legítimos.

- Los ingenieros sociales también están utilizando algoritmos de aprendizaje automático combinados con software de mapeo facial para crear deepfakes convincentes.

- Los actores malintencionados están utilizando IA para lanzar ataques a velocidad de máquina, es decir, ransomware y otros ataques automatizados que se propagan y/o mutan muy rápidamente y son prácticamente imposibles de neutralizar utilizando mecanismos de respuesta dependientes de humanos.

- Los hackers están utilizando IA para adivinar contraseñas y superar CAPTCHAs, obteniendo acceso no autorizado a datos sensibles.

- Los actores de amenazas están creando IA que puede identificar vulnerabilidades de manera autónoma, planear y llevar a cabo campañas de ataque, usar sigilo para evitar defensas y recopilar y minar datos de sistemas infectados e inteligencia de código abierto.

Las organizaciones que usan extensivamente IA y automatización para mejorar sus capacidades de ciberseguridad estarán mejor posicionadas para defenderse contra el uso de IA por parte de los ciberdelincuentes. En un estudio del Instituto de Investigación Capgemini, el 69% de los ejecutivos dice que la IA resulta en una mayor eficiencia para los analistas de ciberseguridad en la organización. El 69% también cree que la IA es necesaria para responder eficazmente a los ciberataques. Encuentre más estadísticas sobre el impacto positivo de la IA en la ciberseguridad.

Lectura recomendada

Más de 70 estadísticas sobre ciberseguridad para inspirar acción este año

¿Cómo se está mejorando la IA en ciberseguridad?

En respuesta a estas amenazas emergentes, la IA en ciberseguridad se está mejorando continuamente para mantenerse al ritmo de los ciberdelincuentes y adaptarse con el tiempo.

A continuación se presentan las principales maneras en que se está mejorando la IA en ciberseguridad.

1. Mejores entrenamientos para modelos de IA

Los modelos de IA están recibiendo un mejor entrenamiento gracias al aumento de la capacidad de cómputo y al tamaño de los datos de entrenamiento. A medida que estos modelos ingieren mayores cantidades de datos, tienen más ejemplos de los cuales aprender y pueden sacar conclusiones más precisas y matizadas de los ejemplos que se les presentan.

Como resultado, las herramientas de IA en ciberseguridad son mejores para identificar patrones y anomalías en grandes conjuntos de datos y aprender de incidentes pasados, lo que les permite predecir amenazas potenciales con mayor precisión, entre otros casos de uso en ciberseguridad.

2. Avances en la tecnología de procesamiento de lenguaje

Gracias al aumento de los recursos de datos y al poder de cómputo, la tecnología de procesamiento de lenguaje ha realizado avances significativos en los últimos años. Estos avances, incluyendo capacidades mejoradas para aprender de datos complejos y sensibles al contexto, mejorarán significativamente las herramientas de IA en ciberseguridad que generan automáticamente instrucciones de remediación paso a paso, inteligencia de amenazas y otros códigos o textos.

3. Integración de inteligencia de amenazas

Los sistemas de IA en ciberseguridad se están mejorando mediante la integración con fuentes de inteligencia de amenazas. Esto les permite mantenerse actualizados sobre la información de amenazas más reciente y ajustar sus defensas en consecuencia.

4. Aprendizaje profundo

Un subconjunto del aprendizaje automático, el aprendizaje profundo es una red neuronal con tres o más capas. Simulando el comportamiento del cerebro humano, estas redes neuronales intentan aprender de grandes cantidades de datos y hacer predicciones más precisas que una red neuronal de una sola capa.

Debido a su capacidad para procesar grandes cantidades de datos y reconocer patrones complejos, la tecnología de aprendizaje profundo está ayudando a contribuir a una búsqueda, gestión y respuesta a amenazas más precisa.

5. Más recursos para el desarrollo y uso de la IA

A medida que el desarrollo y uso de la IA continúan creciendo rápidamente en ciberseguridad y otras industrias, los gobiernos y otros organismos autorizados como el NIST, CISA y OWASP están publicando recursos para ayudar a individuos y empresas a gestionar los riesgos mientras aprovechan los beneficios. Estos recursos ayudarán a proporcionar a los desarrolladores mejores prácticas para mejorar la IA en ciberseguridad y más allá. Algunos ejemplos incluyen:

Aprovechando el poder de la IA en su estrategia de ciberseguridad

La IA se utiliza cada vez más en la ciberseguridad para cosechar una serie de beneficios, desde mejorar la eficiencia de los profesionales de la ciberseguridad hasta identificar y responder a amenazas críticas en menos tiempo.

Secureframe se compromete a simplificar la seguridad y el cumplimiento con IA. Sus últimas innovaciones en IA incluyen:

- Comply IA para Remediación proporciona orientación de remediación impulsada por IA para ayudar a acelerar la remediación en la nube y el tiempo de cumplimiento.

- Comply IA para Riesgos automatiza el proceso de evaluación de riesgos para ahorrarle tiempo y reducir los costos de mantener un programa de gestión de riesgos sólido.

- Comply IA para Políticas aprovecha la IA generativa para que pueda ahorrar horas escribiendo y refinando políticas.

- La automatización de cuestionarios de Secureframe aprovecha la IA para que pueda responder rápidamente a cuestionarios de seguridad y RFP con más del 90% de precisión.

Para obtener más información sobre cómo Secureframe utiliza la automatización y la IA para simplificar la seguridad y el cumplimiento, programar una demostración.

Guiando la estrategia e implementación de IA de su organización

Siga estas mejores prácticas para implementar eficazmente la IA mientras aborda las preocupaciones relacionadas con la transparencia, la privacidad y la seguridad.

Preguntas Frecuentes

¿Cómo se está utilizando la IA en la ciberseguridad?

La IA se está utilizando en la ciberseguridad para complementar los esfuerzos de los expertos humanos al automatizar tareas que son altamente repetitivas, manuales e tediosas para ellos. Dado que la IA puede analizar enormes volúmenes de datos, identificar patrones que los humanos podrían pasar por alto y adaptar y mejorar sus capacidades a lo largo del tiempo, sobresale en la detección de amenazas, la gestión de amenazas, la respuesta a amenazas, la seguridad de endpoints y la seguridad basada en el comportamiento.

¿Qué es la IA responsable en ciberseguridad?

La IA responsable en ciberseguridad se refiere al diseño y despliegue de inteligencia artificial segura, confiable y de confianza en la industria. El objetivo es aumentar la transparencia y reducir riesgos como el sesgo de IA promoviendo la adopción de mejores prácticas específicas, como las pruebas de equipo rojo.

¿Cómo están cambiando la IA y el aprendizaje automático el panorama de la ciberseguridad?

La IA y el aprendizaje automático se están utilizando para fortalecer la ciberseguridad de maneras sin precedentes, como detectar anomalías ocultas, identificar vectores de ataque y responder automáticamente a incidentes de seguridad. También se están utilizando para lanzar ataques cibernéticos cada vez más sofisticados y frecuentes.